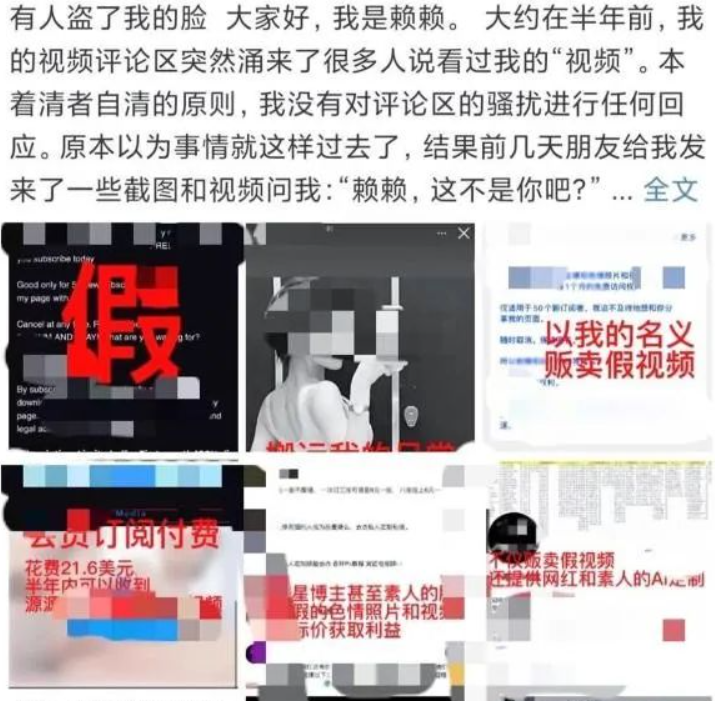

在社交平台有着百万粉丝的网红博主“Caro赖赖_”发文称,有人盗了她的“脸”。

据其介绍,大约在半年前,其视频评论区有多人说看过她的“视频”。本着清者自清的原则,她没进行任何回应。

但前几天,其朋友给她发来一些了截图和视频。但当她看到视频里的女演员的脸和自己一模一样,“Caro赖赖_”称,这时她自己意识到“脸”可能被盗用了。

网络博主在地铁拍的日常生活照,遭不怀好意之人使用AI技术“一键脱衣”,再次引起社会对“AI换脸”等深度合成技术的关注和担忧。

早在2019年,一款名为“ZAO”的AI换脸软件曾风靡网络,只要提供一张照片就能成为影视剧的男女主角,让众多网友趋之若鹜。然而,因侵犯版权、侵害隐私、危害数据安全等问题,“ZAO”很快被下架处理。

然而,随着技术发展和使用门槛降低,“AI换脸”的应用场景越来越多,背后的黑灰产业链也逐渐浮出水面。记者调查发现,目前在网络平台上,售卖明星换脸的淫秽视频、提供视频定制换脸服务、教授换脸技术等已经成为一门生意。

AI成了骗子最佳搭档

AI诈骗并非近些年才开始猖獗起来,早在4年前AI尚处雏形的时期,便有天才罪犯利用AI语音模仿软件冒充德国某公司大老板。

AIGC,即是这两年爆火的AI绘画、AI图片生成,用于生成各种图片、照片。

代表性的产品有ChatGPT、Stable Diffusion、metamind,个个都是圈子里的顶流。

AIGC多用于杀猪盘及朋友亲属诈骗,在陌生人社交APP上发布合成的假照片,吸引受害人上钩。

以网恋的形式一步步诱骗受害人进入情感陷阱,最终以“家里困难、突发意外”等理由向受害人索取钱财。

又或者伪造亲朋好友的自拍照片,骗取跟不上时代的老年人信任,进而施展下一步的欺诈计划。

部分毫无道德底线者,甚至利用人民对深陷灾难中的群众的同情心进行诈捐。

2月份土耳其大地震,某些网友在内容平台上发布AIGC合成的灾难照片,配上“为受害者捐款”的文字。

向广大网友募集捐款,钱是到卡上了,至于捐不捐给灾民就是另一回事了。

给大伙分享简单,却超级有用的防骗技巧

1.遇家人、朋友、同事、伙伴借钱,切莫心急打钱,厚着脸皮提出几个只有你们知道的问题试探,如:上次你借我多少钱来着?妈妈上次打我是什么时候?

2.面子实在挂不住,请设置转账24小时到,趁此期间通过微信、电话、视频、真人见面等途径核实对方真实身份,稍有不对,立刻撤回转账。

3.天上不掉馅饼,没人平白无故带你发财,保持不贪之心,神仙来了也动不了你的钱包。

4.有人拿合成的裸照敲诈你,别慌张,直接报警,哪怕是真照片,一句“AI合成照片”便能洗脱污点。

5.年轻人警惕意识高,一般不容易上当,可是老年人思维迟钝往往是受骗主力群体,要多给老人家做安全工作。

一切诈骗,均离不开钱字,一切诈骗手段,不过利用人性的弱点。

只要不打钱,我们永远站在赢家的位置,守住初心,拒绝诱惑,我们将不存在弱点。

易倾咨询服务号

微信识别二维码关注服务号

易倾咨询服务号

微信识别二维码关注服务号

非微信浏览可先长按或截屏保存图片,

非微信浏览可先长按或截屏保存图片,

易倾咨询服务号

易倾咨询服务号

微信识别二维码关注服务号

微信识别二维码关注服务号